آیا هوش مصنوعی اطلاعات شرکت شما را لو میدهد؟ (راهنمای جامع محرمانگی اطلاعات در سال 1404 برای مدیران)

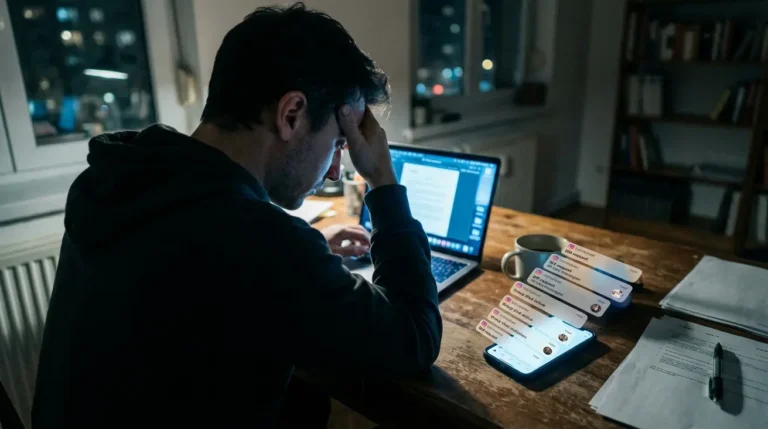

یک سناریوی واقعی را تصور کنید که در پروژههای متعدد شاهد آن بودهایم:

ساعت ۵ بعد از ظهر است و یکی از مدیران مالی شما باید تا فردا صبح یک تحلیل جامع از گزارشهای فصلی سه ماه گذشته ارائه دهد. او برای سرعت بخشیدن به کار، تمام دادههای فروش، حاشیه سود و پیشبینیهای محرمانه را در ChatGPT کپی میکند و مینویسد: «این دادهها را تحلیل و خلاصهسازی کن.»

در عرض چند دقیقه، یک گزارش بینقص تحویل میگیرد و با احساس رضایت به خانه میرود.

اما هزینهی پنهان این «بهرهوری» چیست؟ این دادههای حساس تجاری که مزیت رقابتی شما در بازار هستند، حالا بخشی از حافظه و دادههای آموزشی یک مدل زبان بزرگ (LLM) شدهاند. این دادهها در سرورهای یک شرکت دیگر، در قارهای دیگر، نگهداری میشوند.

این اشتباه ساده، چالشی جدی برای محرمانگی اطلاعات و یک نشت اطلاعات خاموش و غیرقابل ردیابی است. دفعه بعد که رقیب شما از یک ابزار مشابه سوالی هوشمندانه بپرسد، ممکن است پاسخی دریافت کند که بر اساس تحلیل دادههای شما شکل گرفته است. این کابوس، واقعیت بسیاری از شرکتهایی است که بدون استراتژی امنیتی، به استقبال هوش مصنوعی میروند.

کالبدشکافی ریسکها: ۳ حفره امنیتی کلیدی در استفاده از هوش مصنوعی

استفاده از هوش مصنوعی مولد بدون درک عمیق مکانیزمهای آن، مانند رانندگی با چشم بسته در اتوبان است. در تجربه ما در کارورا، ریسکهای اصلی را میتوان در سه دسته کلیدی طبقهبندی کرد:

۱. نشت داده (Data Leakage) و آموزش ناخواسته مدلها

این همان سناریوی کابوسواری است که در ابتدا شرح دادیم. وقتی کارمندان شما از نسخههای عمومی و رایگان ابزارهای AI استفاده میکنند، تقریباً همیشه با شرایطی موافقت میکنند که به آن شرکت اجازه میدهد از دادههای ورودی برای آموزش و بهبود مدلهای آیندهاش استفاده کند.

این یعنی استراتژیهای قیمتگذاری، لیست مشتریان، کدهای نرمافزاری اختصاصی و صورتجلسات هیئت مدیره شما، به بخشی از دانش عمومی یک مدل جهانی تبدیل میشود. این بزرگترین تهدید برای امنیت هوش مصنوعی سازمان شماست.

۲. مسمومیت داده (Data Poisoning) و خروجیهای مخرب

این یک ریسک پیشرفتهتر است. اگر سیستم شما برای تصمیمگیریهای کلیدی به یک مدل AI متکی باشد که از منابع خارجی داده دریافت میکند (مثلاً تحلیل سنتیمنت بازار از روی شبکههای اجتماعی)، یک عامل مخرب میتواند با تزریق دادههای جعلی و هدفمند، مدل را «مسموم» کند.

این مسمومیت باعث میشود مدل خروجیهای نادرست و جهتدار تولید کند که میتواند منجر به تصمیمات استراتژیک فاجعهبار شود.

۳. عدم انطباق با قوانین (Compliance Risk)

اگر با شرکتهای بینالمللی کار میکنید یا دادههای شهروندان کشورهای دیگر را پردازش میکنید، با ریسکهای قانونی جدی مواجه هستید. قوانینی مانند GDPR در اروپا، جرایم سنگینی برای پردازش دادههای شخصی بدون رضایت و خارج از پروتکلهای امنیتی تعیین کردهاند.

استفاده از یک سرویس AI که سرورهای آن در یک منطقه جغرافیایی غیرمجاز قرار دارد، میتواند به فسخ قراردادها و پرداخت جریمههای میلیون دلاری منجر شود. این دسته از ریسکهای LLM اغلب نادیده گرفته میشوند.

راه حل اول: قلعه دیجیتال شما – چرا اتوماسیون On-Premise کلید محرمانگی اطلاعات است؟

راه حل بنیادین برای حذف کامل ریسک نشت اطلاعات، ساختن یک «قلعه دیجیتال» است. معماری On-Premise به این معناست که تمام پردازشهای هوش مصنوعی، از مدل زبان بزرگ گرفته تا موتور اتوماسیون، روی سرورهای خود شما و داخل شبکه شرکت شما اجرا میشوند.

دادهها هرگز، حتی برای یک میلیثانیه، از محیط تحت کنترل شما خارج نمیشوند.

در مدل ابری (Cloud)، جریان داده به این شکل است:

سرور شما -> (ارسال دادههای حساس از طریق اینترنت) -> سرور شرکت AI -> (پردازش) -> سرور شرکت AI -> (بازگشت نتیجه) -> سرور شما

نقطه ضعف: دادههای شما در اختیار یک شرکت ثالث قرار میگیرد.

اما در مدل On-Premise AI، جریان داده یک حلقه بسته و امن است:

سرور شما (پردازش داخلی بدون خروج از شبکه) مدل AI روی سرور شما

نقطه قوت: کنترل کامل و صددرصدی بر روی دادهها.

در پروژههای واقعی دیدهایم که ابزارهایی مانند n8n.io یا فریمورکهایی مانند Ollama به شرکتها اجازه میدهند تا موتورهای قدرتمند اتوماسیون و حتی مدلهای زبان بزرگ را به صورت کاملاً خصوصی (Self-Hosted) پیادهسازی کنند. این رویکرد، بالاترین سطح اتوماسیون امن را تضمین میکند و خیال شما را از بابت محرمانگی اطلاعات راحت میسازد.

راه حل دوم: استراتژیهای پیشرفته حفاظت از دادهها برای ابزارهای ابری

ما در کارورا معتقد به راهحلهای مهندسیشده و واقعبینانه هستیم. حقیقت این است که پیادهسازی On-Premise همیشه امکانپذیر یا مقرونبهصرفه نیست. گاهی قدرت مدلهای پیشرفتهای مانند GPT-4.0 آنقدر زیاد است که استفاده از نسخه ابری آن توجیه اقتصادی دارد.

در این موارد، به جای حذف کامل، باید ریسک را هوشمندانه مدیریت کرد.

الف) ناشناسسازی و پوشاندن داده (Anonymization & Masking)

قبل از ارسال هرگونه داده به یک API ابری، باید تمام اطلاعات حساس و قابل شناسایی را از آن حذف کنید. این فرآیند که به آن Data Masking میگویند، مانند ماژیک کشیدن روی بخشهای محرمانه یک سند قبل از ارسال آن است.

به عنوان مثال، این تابع ساده پایتون را ببینید که اطلاعات حساس را از یک متن حذف میکند:

`python

import re

def mask_sensitive_data(text: str) -> str:

“””

A simple function to mask National ID, phone numbers, and names from a text.

NOTE: This is a simplified example. Real-world scenarios require more robust logic.

“””

# Mask Iranian National ID (10 digits)

text = re.sub(r’\b\d{10}\b’, ‘[NATIONAL_ID]’, text)

# Mask Iranian mobile numbers (e.g., 09121234567, +989121234567)

text = re.sub(r'(\+98|0)?9\d{9}’, ‘[PHONE_NUMBER]’, text)

# A simple (and not foolproof) way to mask common names

# In a real project, we’d use a comprehensive name dictionary or an NLP model.

known_names = [“رضا”, “علی”, “محمد”, “سارا”, “مریم”]

for name in known_names:

text = text.replace(name, ‘[NAME]’)

return text

Example Usage:

original_text = “قرارداد با آقای محمد به شماره ملی 0012345678 و تلفن 09129876543 بسته شد.”

masked_text = mask_sensitive_data(original_text)

print(masked_text)

Output: قرارداد با آقای [NAME] به شماره ملی [NATIONAL_ID] و تلفن [PHONE_NUMBER] بسته شد.

`

پیادهسازی چنین مکانیزمهایی تضمین میکند که حتی اگر دادهها به سرور خارجی ارسال شوند، هیچ اطلاعات استراتژیکی در آنها وجود ندارد.

ب) استفاده از نسخههای Enterprise

بسیاری از ارائهدهندگان خدمات AI (مانند OpenAI و Microsoft Azure) نسخههای Enterprise یا Business ارائه میدهند. این نسخهها از نظر قراردادی متعهد میشوند که از دادههای ارسالی شما از طریق API برای آموزش مدلهای خود استفاده نکنند (Zero Data Retention Policy).

اگرچه هزینه این سرویسها بالاتر است، اما این هزینه در واقع نوعی «بیمه محرمانگی داده» است.

ج) پیادهسازی Gateway امن

یک راهکار معماری پیشرفته، ایجاد یک API Gateway داخلی است. تمام درخواستهای کارمندان یا سیستمها به سرویسهای AI خارجی، ابتدا از این Gateway عبور میکنند.

این Gateway میتواند به صورت متمرکز وظایف زیر را انجام دهد:

چکلیست امنیتی ۲۰۲۶: نقشه راه شما برای محرمانگی اطلاعات

برای پیادهسازی ایمن هوش مصنوعی، به یک نقشه راه مشخص نیاز دارید. این چکلیست را به عنوان نقطه شروع در سازمان خود به کار بگیرید:

1. ممیزی و طبقهبندی دادهها: اولین قدم، شناخت داراییهایتان است. تمام دادههای شرکت را به دستههایی مانند «عمومی»، «داخلی»، «محرمانه» و «فوق محرمانه/استراتژیک» طبقهبندی کنید. مشخص کنید کدام دادهها هرگز نباید از سرورهای شما خارج شوند.

2. تدوین سیاستنامه استفاده از ابزارهای AI: یک سند واضح و شفاف برای تمام کارکنان تهیه کنید. در این سند مشخص کنید:

3. انتخاب معماری مناسب (On-Premise vs. Cloud): بر اساس طبقهبندی دادههای خود، یک مدل تصمیمگیری ایجاد کنید. برای پردازش دادههای «فوق محرمانه»، معماری On-Premise تنها گزینه است. برای دادههای «داخلی» پس از ناشناسسازی، شاید بتوان از یک API ابری Enterprise استفاده کرد.

4. برگزاری دورههای آموزشی برای تیمها: بزرگترین ریسک امنیتی، کارمندی است که از خطرات آگاه نیست. دورههای آموزشی منظم در مورد ریسکهای امنیتی هوش مصنوعی و سیاستنامه شرکت برگزار کنید.

5. تعریف مسئول امنیت دادههای هوش مصنوعی: یک فرد یا یک تیم مشخص را به عنوان مسئول نظارت بر پیادهسازی امن AI و پاسخ به حوادث احتمالی معرفی کنید. این فرد باید بر اجرای سیاستنامه و ممیزیهای دورهای نظارت داشته باشد.

چکلیست جامع امنیت هوش مصنوعی

این نقشه راه را دانلود کنید و اولین قدم عملی را برای محافظت از دادههای استراتژیک خود بردارید. این چکلیست به شما کمک میکند تا هیچ حفره امنیتی را از قلم نیندازید.

از تئوری تا اجرا: اولین قدم برای ساخت یک سیستم اتوماسیون امن

ترس از ریسکهای امنیتی نباید سازمان شما را از مزایای تحولآفرین هوش مصنوعی و اتوماسیون محروم کند.

راهحل، نادیده گرفتن این تکنولوژی نیست، بلکه مدیریت هوشمندانه و مهندسیشدهی ریسکهای آن است. با معماری صحیح و سیاستگذاری شفاف، میتوانید از قدرت AI برای کاهش هزینهها و افزایش بهرهوری استفاده کنید، در حالی که محرمانگی اطلاعات استراتژیک خود را به طور کامل حفظ میکنید.

مسیر رسیدن به مزیت رقابتی پایدار در دنیای امروز، از طریق هوشمندسازی کسبوکار با اتوماسیون امن میگذرد.

آمادهاید قلعه دیجیتال خود را بسازید؟

هنوز مطمئن نیستید از کجا شروع کنید؟ بیایید در یک جلسه استراتژی رایگان ۱۵ دقیقهای، نقشه راه امنیت دادههای کسبوکار شما را ترسیم کنیم.

سوالات متداول

آیا پیادهسازی On-Premise AI به طور قابل توجهی گرانتر از راهکارهای ابری است؟

در ابتدا، هزینه راهاندازی سختافزار و نرمافزار On-Premise میتواند بالاتر از هزینه اشتراک ماهانه یک سرویس ابری باشد. اما باید این را به عنوان یک سرمایهگذاری (CAPEX) در نظر گرفت. ROI بلندمدت آن از طریق جلوگیری از یک نشت اطلاعاتی که میتواند میلیونها دلار خسارت (شامل جریمههای قانونی، از دست رفتن مشتریان و آسیب به برند) به همراه داشته باشد، به دست میآید. برای دادههای حیاتی، این هزینه کاملاً قابل توجیه است.

آیا نمیتوانیم به سادگی به کارمندان بگوییم از دادههای حساس در ابزارهای AI عمومی استفاده نکنند؟

سیاستگذاری و آموزش ضروری است، اما کافی نیست. در فشار کاری روزمره، احتمال «اشتباه انسانی» بسیار بالاست. بهترین رویکرد، ترکیب آموزش با راهحلهای فنی (Technical Controls) است. یک Gateway امن که به صورت خودکار دادههای حساس را مسدود یا Mask میکند، بسیار قابل اعتمادتر از تکیه صرف بر حافظه و دقت انسان است.

اولین و حیاتیترین قدمی که باید از فردا بردارم چیست؟

ممیزی و طبقهبندی دادهها. تا زمانی که ندانید ارزشمندترین و حساسترین دادههای شما چه هستند و کجا قرار دارند، نمیتوانید از آنها محافظت کنید. همین فردا یک جلسه با مدیران کلیدی خود بگذارید و فرآیند شناسایی و دستهبندی «جواهرات سازمانی» (Crown Jewels) خود را آغاز کنید.

آیا مدلهای زبان بزرگ متنباز (Open-Source LLMs) برای استفاده On-Premise امن هستند؟

بله، این یکی از بهترین گزینهها برای اتوماسیون امن است. مدلهایی مانند سری Llama یا Mistral را میتوان به صورت کامل بر روی سرورهای داخلی شما اجرا کرد. این کار به شما قدرت یک LLM پیشرفته را میدهد، در حالی که کنترل صددرصدی بر روی دادهها و مدل را حفظ میکنید. امنیت این رویکرد بسیار بالاست. ⚠️ نکته امنیتی: پیادهسازی On-Premise، مسئولیت امنیت زیرساخت شبکه (مانند فایروالها، کنترل دسترسی و مانیتورینگ) را به طور کامل به عهده تیم شما میگذارد. یک پیکربندی نادرست میتواند تمام مزایای امنیتی این روش را از بین ببرد.